-

溫始地送風(fēng)風(fēng)盤 —— 革新家居空氣享受的藝術(shù)品

-

溫始·未來生活新定義 —— 智能調(diào)濕新風(fēng)機(jī)

-

秋季舒適室內(nèi)感,五恒系統(tǒng)如何做到?

-

大眾對五恒系統(tǒng)的常見問題解答?

-

五恒空調(diào)系統(tǒng)基本概要

-

如何締造一個舒適的室內(nèi)生態(tài)氣候系統(tǒng)

-

舒適室內(nèi)環(huán)境除濕的意義

-

暖通發(fā)展至今,怎樣選擇當(dāng)下產(chǎn)品

-

怎樣的空調(diào)系統(tǒng)ZUi值得你的選擇?

-

五恒系統(tǒng)下的門窗藝術(shù):打造高效節(jié)能與舒適并存的居住空間

西藏科研級羊毛羊絨成分自動定量系統(tǒng)服務(wù)

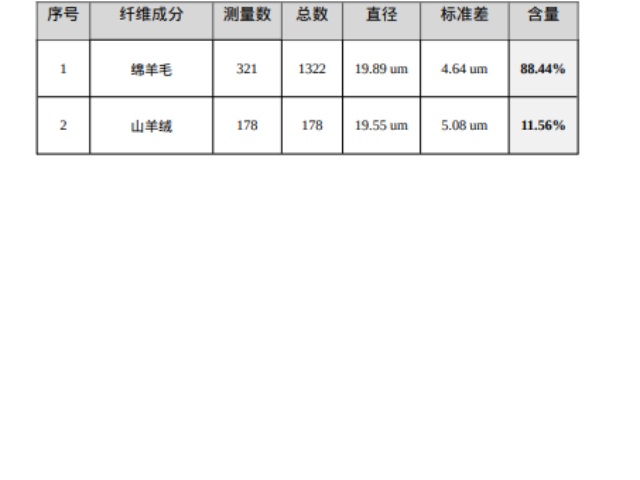

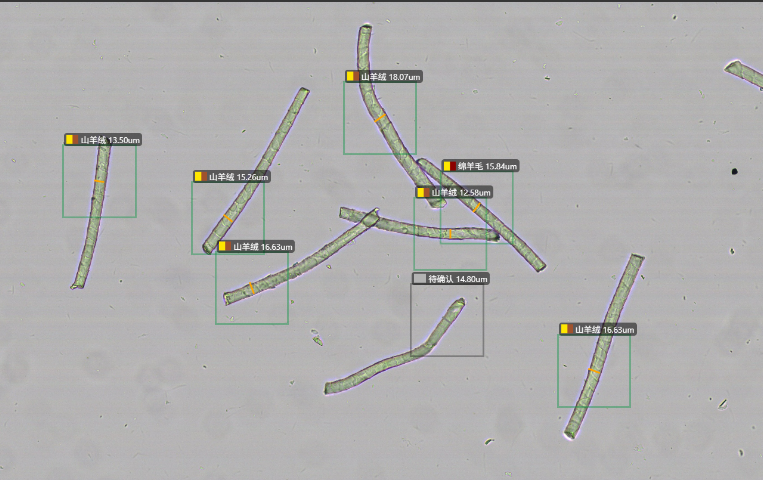

系統(tǒng)在極低 / 極高成分比例場景中展現(xiàn)出***性能:當(dāng)羊絨含量低至 0.5%(痕量檢測)時,通過超分辨率圖像重建技術(shù),仍可識別出 5 根以上羊絨纖維并準(zhǔn)確定量;當(dāng)羊毛含量超過 95% 時,智能過濾算法自動排除高密度羊毛纖維的干擾,確保微量羊絨成分的檢測精度。這種全量程適應(yīng)性,覆蓋了從**純羊絨制品到大眾混紡面料的全產(chǎn)品線檢測需求。每份樣本從進(jìn)入設(shè)備開始,其檢測路徑被全程記錄:進(jìn)樣時間、掃描工位、分析算法版本、復(fù)核人員簽名等信息形成完整的操作日志。當(dāng)出現(xiàn)檢測結(jié)果異常時,可通過時間軸快速定位問題環(huán)節(jié)(如某時段光源模塊老化導(dǎo)致的圖像偏色),實現(xiàn) “問題可追溯、責(zé)任可界定”,為實驗室內(nèi)部質(zhì)量管控提供了透明化的管理工具。動態(tài)調(diào)整掃描參數(shù)適應(yīng)不同樣本,減少人工干預(yù)與設(shè)置錯誤。西藏科研級羊毛羊絨成分自動定量系統(tǒng)服務(wù)

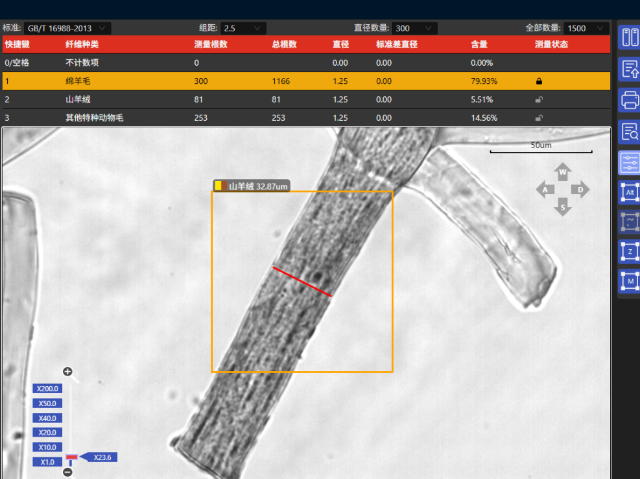

多層對焦圖像的合成過程采用金字塔融合算法,通過高斯金字塔分解各層圖像的低頻輪廓與高頻細(xì)節(jié),再按權(quán)重疊加(焦點清晰區(qū)域權(quán)重占70%),**終生成分辨率達(dá)4000×3000像素的全清視圖。用戶可通過鼠標(biāo)滾輪無級縮放(20-200倍),任意區(qū)域的纖維鱗片結(jié)構(gòu)均無鋸齒化失真。與傳統(tǒng)顯微鏡的單焦平面成像相比,該技術(shù)使纖維特征的可辨識度提升3倍,尤其對彎曲纖維的中段、粗細(xì)過渡區(qū)域等易漏檢部位,檢測完整性從75%提升至98%以上。云端數(shù)據(jù)中心部署于金融級機(jī)房,采用同城雙活+異地災(zāi)備架構(gòu),確保99.999%的數(shù)據(jù)可用性。企業(yè)不同部門(質(zhì)檢、研發(fā)、采購)可通過角色權(quán)限設(shè)置,共享特定維度的數(shù)據(jù):研發(fā)部可獲取纖維直徑分布與面料強(qiáng)度的關(guān)聯(lián)數(shù)據(jù),采購部可查看原料批次的成分波動趨勢。數(shù)據(jù)導(dǎo)出支持CSV、Excel、PDF等多種格式,且自動隱藏未授權(quán)字段(如審核人員批注),在保障數(shù)據(jù)安全的前提下,比較大化檢測數(shù)據(jù)的跨部門應(yīng)用價值。廣東通量大羊毛羊絨成分自動定量系統(tǒng)替代人工方案系統(tǒng)通過 AI 自動分類每根纖維類型,同步統(tǒng)計生成成分檢測結(jié)果。

用戶可對專屬算法庫進(jìn)行版本管理,記錄每次訓(xùn)練的關(guān)鍵參數(shù)(如新增纖維類型、調(diào)整的特征權(quán)重、訓(xùn)練樣本來源),并支持版本回滾(如發(fā)現(xiàn)某版本模型誤判率升高時,可恢復(fù)至歷史穩(wěn)定版本)。算法庫更新時,系統(tǒng)自動進(jìn)行交叉驗證(使用10%的保留樣本測試新模型),確保新版本的準(zhǔn)確率不低于舊版本0.5%,形成“訓(xùn)練-驗證-應(yīng)用”的閉環(huán)管理,避免因模型盲目迭代導(dǎo)致的檢測風(fēng)險。針對長時間連續(xù)掃描可能出現(xiàn)的機(jī)械位移偏差,系統(tǒng)每完成50份樣本檢測,自動插入標(biāo)準(zhǔn)校正片進(jìn)行位置校準(zhǔn)。校正過程中,通過圖像匹配算法計算掃描坐標(biāo)系的偏移量(X/Y軸誤差>5μm時觸發(fā)自動校準(zhǔn)),確保后續(xù)檢測的定位精度。該機(jī)制使設(shè)備在24小時連續(xù)運行時的累計位移誤差<10μm,較傳統(tǒng)設(shè)備需人工每日校準(zhǔn)的操作模式,可靠性提升3倍以上。

生成專屬算法庫時,系統(tǒng)采用小樣本學(xué)習(xí)(Few-ShotLearning)技術(shù),*需50-100張目標(biāo)纖維圖像即可啟動訓(xùn)練,較傳統(tǒng)深度學(xué)習(xí)模型所需的萬級樣本量,效率提升95%以上。訓(xùn)練過程中,自動數(shù)據(jù)增強(qiáng)功能(旋轉(zhuǎn)、縮放、噪聲添加)將有效樣本量擴(kuò)展10倍,確保在稀缺樣本場景下仍能構(gòu)建高精度模型。某特種纖維企業(yè)利用該功能,*用3天時間完成對新引進(jìn)羊駝毛纖維的識別模型訓(xùn)練,較外部委托建模節(jié)省2個月周期與50萬元成本。進(jìn)樣系統(tǒng)兼容紗線、面料切片、散纖維等3種樣本形態(tài),通過智能載樣架的壓力傳感器自動識別樣本類型并調(diào)整掃描參數(shù):紗線樣本采用逐根平鋪掃描模式,確保纖維無重疊;面料切片啟用邊緣檢測算法,自動排除織物組織結(jié)構(gòu)的干擾;散纖維樣本通過振動盤均勻分布,避免堆積導(dǎo)致的檢測盲區(qū)。實測顯示,對克重0.1g-5g的樣本,檢測完整性均達(dá)99%以上,解決了傳統(tǒng)設(shè)備對不同樣本形態(tài)需人工調(diào)整的痛點。設(shè)備可識別紗線、面料切片、散纖維等多種樣本形態(tài)并智能處理。

設(shè)備搭載智能進(jìn)樣托盤與機(jī)械臂協(xié)同系統(tǒng),支持24小時連續(xù)作業(yè)時的樣本自動識別與定位。AI分類模塊采用增量學(xué)習(xí)算法,在掃描過程中實時分析纖維形態(tài)特征,每根纖維的軸向鱗片密度、髓質(zhì)層分布等12項參數(shù)被同步采集,分類耗時控制在0.3秒/根。與傳統(tǒng)人工逐幀鏡檢需頻繁調(diào)整視野相比,系統(tǒng)通過機(jī)械視覺系統(tǒng)實現(xiàn)300μm×300μm區(qū)域的快速掃描,單樣本平均掃描路徑規(guī)劃效率提升70%。夜間作業(yè)模式下,設(shè)備自動切換至低功耗掃描頻率,同時保持檢測精度不變,為三班制生產(chǎn)企業(yè)提供全天候質(zhì)量監(jiān)控能力,徹底解決人工輪班導(dǎo)致的檢測時段斷層問題。實時監(jiān)控設(shè)備狀態(tài),主動推送維護(hù)提醒,減少停機(jī)損失。西藏科研級羊毛羊絨成分自動定量系統(tǒng)服務(wù)

羊毛羊絨成分自動定量系統(tǒng)可一鍵實現(xiàn)含量計算,7 分鐘出具準(zhǔn)確報告。西藏科研級羊毛羊絨成分自動定量系統(tǒng)服務(wù)

在傳統(tǒng)人工檢測中,不同人員對 “鱗片高度”“髓質(zhì)層比例” 等指標(biāo)的判斷存在主觀差異,導(dǎo)致同一樣本多次檢測結(jié)果波動可達(dá) 2%-5%。本系統(tǒng)通過建立統(tǒng)一的數(shù)字化檢測標(biāo)準(zhǔn),將纖維形態(tài)學(xué)指標(biāo)轉(zhuǎn)化為可量化的算法參數(shù),所有檢測步驟由程序自動執(zhí)行,消除了人為操作變量。經(jīng)中國紡織科學(xué)研究院認(rèn)證,系統(tǒng)的組間檢測重復(fù)性誤差≤0.5%,組內(nèi)誤差≤0.3%,達(dá)到 CNAS 實驗室認(rèn)證的比較高精度要求,為企業(yè)建立內(nèi)部質(zhì)量管控標(biāo)準(zhǔn)、參與行業(yè)標(biāo)準(zhǔn)制定提供了技術(shù)背書。西藏科研級羊毛羊絨成分自動定量系統(tǒng)服務(wù)

- 四川實驗室用纖維直徑檢測設(shè)備解決方案 2025-05-30

- 廣東質(zhì)檢用纖維直徑檢測設(shè)備選擇 2025-05-30

- 天津新型纖維直徑檢測設(shè)備哪家好 2025-05-30

- 北京自動化纖維直徑檢測設(shè)備選擇 2025-05-30

- 江西科研級纖維直徑檢測設(shè)備怎么選 2025-05-30

- 四川自動化纖維直徑檢測設(shè)備哪個好 2025-05-30

- 江蘇智能型纖維直徑檢測設(shè)備方案 2025-05-30

- 山東帶AI算法纖維直徑檢測設(shè)備服務(wù) 2025-05-30

- 通量大纖維直徑檢測設(shè)備服務(wù) 2025-05-30

- 四川在線式纖維直徑檢測設(shè)備哪家好 2025-05-30

- 濱州IC卡水表怎么充值 2025-05-31

- 南寧單模BL-DAS主要功能 2025-05-31

- 上海四點彎曲試驗機(jī)銷售廠家 2025-05-31

- 陜西DWTT試驗機(jī)廠家直銷 2025-05-31

- 遼寧是什么顯微CT調(diào)試 2025-05-31

- 內(nèi)蒙古硫化氫氣體報警控制器解決方案 2025-05-31

- 廣東OBD汽摩配件哪家好 2025-05-31

- 山東氣動薄膜調(diào)節(jié)閥門 2025-05-31

- 木板微波水分儀哪個好 2025-05-31

- 無錫mems皮拉尼真空計設(shè)備供應(yīng)商 2025-05-31